Równanie płci – jak modele językowe wzmacniają stereotypy?

Table of Contents

Wprowadzenie

W jaki sposób modele sztucznej inteligencji mogą wzmacniać stereotypy płciowe? W przygotowywanym raporcie pt. „Równanie Płci: Co mówią nam modele językowe?” przyglądamy się, jak sztuczna inteligencja przetwarza język związany z płcią, analizując ukryte uprzedzenia zawarte w danych używanych do treningu modeli AI.

Modele językowe, stosowane powszechnie w wyszukiwarkach czy chatbotach, uczą się z ogromnych zbiorów danych dostępnych w internecie. Niestety, te dane często zawierają nieuświadomione uprzedzenia, które mogą być utrwalane przez sztuczną inteligencję.

Dlaczego ten raport jest ważny?

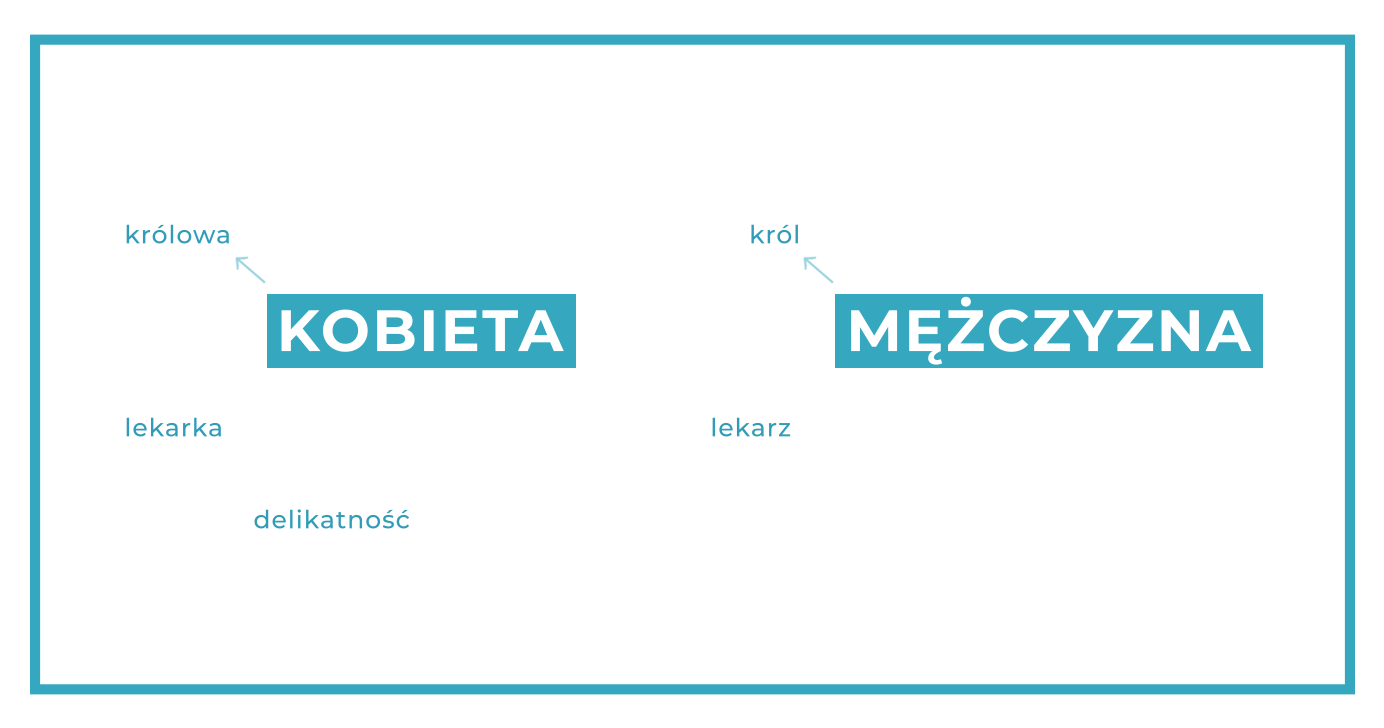

Raport powstał, gdy zauważyliśmy, że modele językowe różnie interpretują słowa w zależności od tego, czy odnoszą się one do mężczyzn, czy kobiet. Przykładowo, operacje wektorowe na embeddingach ujawniają, że AI inaczej rozumie pojęcie „pracy” w odniesieniu do kobiet i mężczyzn. Naszym celem jest pokazanie skali tego zjawiska oraz wskazanie możliwych dróg do jego neutralizacji.

Co znajdziesz w raporcie?

Raport przedstawia analizę skojarzeń modeli AI, korzystając z techniki zwanej embeddingami. Badamy m.in.:

- Jak modele AI interpretują słowa związane z płcią?

- Jakie są konsekwencje tych skojarzeń dla społeczeństwa i biznesu?

- W jaki sposób można zneutralizować te uprzedzenia?

Dlaczego ten raport ma znaczenie dla biznesu?

Modele językowe AI są powszechnie wykorzystywane w procesach takich jak:

- Rekrutacja – analiza języka ofert pracy, która może przyciągać lub odstraszać określone grupy kandydatów.

- Wsparcie sprzedaży – personalizacja komunikacji marketingowej, dostosowanej do odbiorców bez wzmacniania stereotypów.

- Budowanie zespołów – identyfikacja i eliminacja uprzedzeń w ofertach pracy, zwiększająca równość zgłoszeń.

Nasz cel

Chcemy, aby sztuczna inteligencja była bardziej świadoma społecznie i neutralna wobec płci. Raport jest początkiem dyskusji o odpowiedzialnym projektowaniu AI, które będzie wspierać sprawiedliwe społeczeństwo.

Spis treści raportu

- Jak AI „rozumie” płeć?

- Analiza modeli językowych

- Embeddingi – czym są i jak działają?

- Ukryte uprzedzenia i ich konsekwencje

- Stereotypy płciowe w kontekście pracy

- Jak projektować sprawiedliwe modele AI?

- Zastosowania biznesowe

- Przyszłość modeli językowych

Zespół badawczy

Za raportem stoi nasz doświadczony zespół specjalistów od AI i analizy tekstów. Misją naszego zespołu jest zwiększanie świadomości wpływu AI na społeczne postrzeganie płci oraz promowanie odpowiedzialnych rozwiązań technologicznych.

Podsumowanie

Raport ukaże się już wkrótce! Zapisz się do naszego newslettera, aby nie przegapić premiery oraz poznać wyniki, które pomogą Twojej firmie odpowiedzialnie korzystać z AI.

Zapowiedź raportu, zawierająca fragment jednego z rozdziałów, jest dostępna pod adresem: Zapowiedź raportu.

Więcej szczegółów znajdziesz na naszym repozytorium na GitHub.